Tutkulu bir teknoloji meraklısı ve yapay zeka hayranı olarak, bu alandaki çığır açan araştırma ve gelişmeleri her zaman takip ediyorum. Kısa bir süre önce OpenAI’nin blogunda, insanüstü yapay zekâ sistemlerinin uyum ve güvenliğini sağlamaya yönelik acil ihtiyacı ele alan “Superalignment Fast Grants” başlıklı ilgi çekici bir makaleye rastladım. Eric Schmidt ile işbirliği içinde yürütülen bu 10 milyon dolarlık hibe programı, önümüzdeki on yıl içinde süper zeki yapay zekanın geliştirilmesiyle ortaya çıkacak teknik zorlukları ele almayı amaçlıyor.

- Hizalama Zorluğu: Süper Yapay Zeka Çağında Güvenliğin Sağlanması

- OpenAI’nin Vizyonu: Araştırma Topluluğuyla İşbirliği Yapmak

- Araştırma İlgi Yönleri: Zayıftan Güçlüye Genellemeyi Keşfetmek

- Modelin İç Kısımlarını Çözmek: Yorumlanabilirlik Arayışı

- Sık Sorulan Sorular

- Superalignment Fast Grants programı nedir?

- Araştırmacılar Superalignment Fast Grants programına nasıl başvurabilir?

- Hibelere başvurmak için hizalama araştırmalarında önceden deneyim gerekli mi?

- Superalignment Fast Grants programı için ilgi duyulan belirli araştırma yönleri nelerdir?

Yapay zeka sistemlerinin giderek daha güçlü hale geldiği bir dünyada, potansiyel faydalar muazzamdır. Bununla birlikte, bu ilerlemeyle birlikte gelen potansiyel riskleri de kabul etmeliyiz. OpenAI, özellikle insan anlayışını aşan insanüstü yeteneklerle uğraşırken, güvenliğini sağlamak için yapay zeka sistemlerini hizalamanın aciliyetini kabul etmektedir.

Hizalama Zorluğu: Süper Yapay Zeka Çağında Güvenliğin Sağlanması

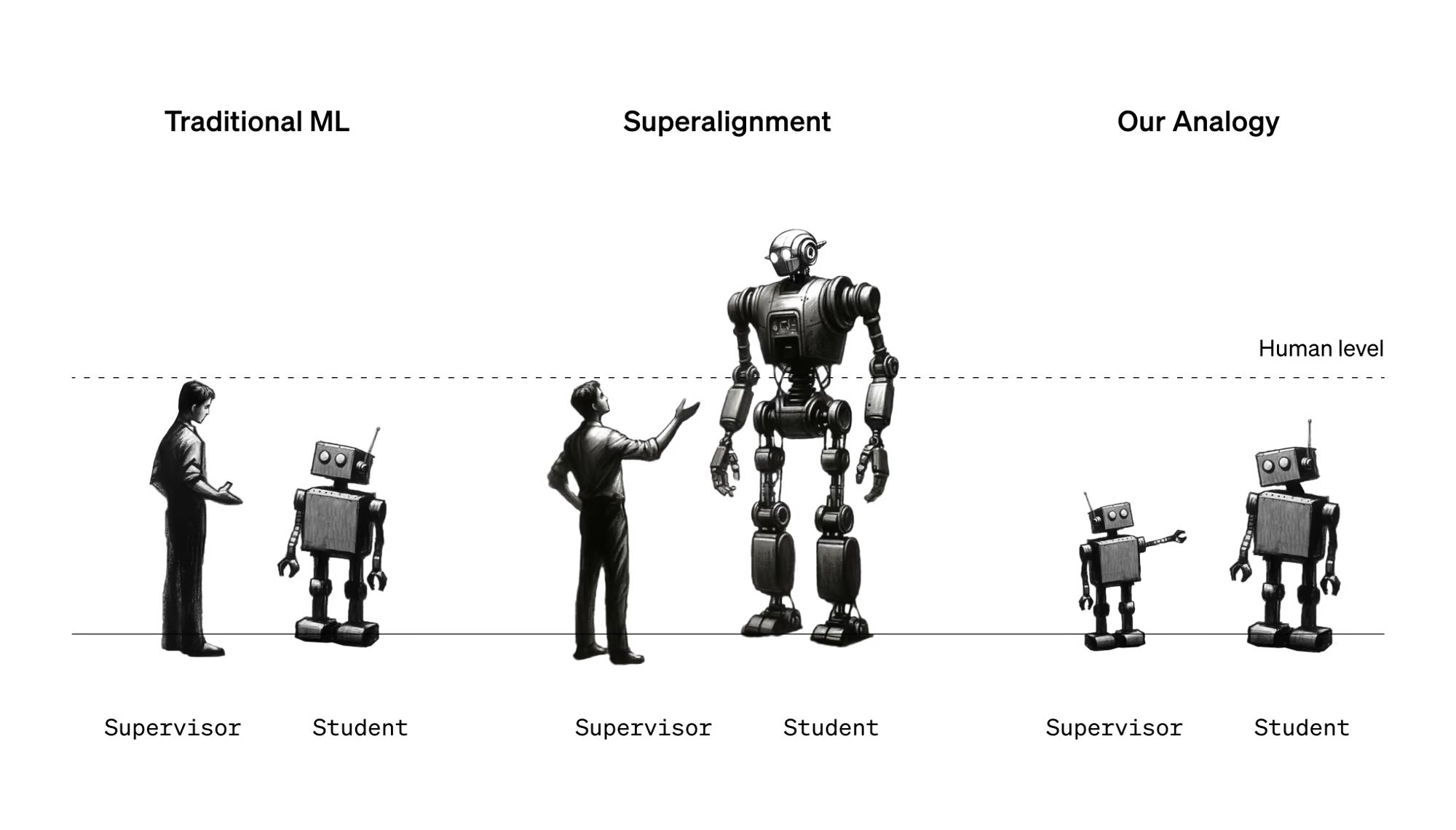

Geleneksel olarak, YZ sistemleri insan geri bildiriminden takviye öğrenme (RLHF) kullanılarak hizalanmıştır. Ancak, gelecekteki insanüstü YZ sistemlerinin hizalanması yeni ve niteliksel olarak farklı zorluklar ortaya koymaktadır. Bu sistemler, insan kavrayışının ötesinde olabilecek karmaşık ve yaratıcı davranışlara sahip olacaktır. Örneğin, bir milyon satırlık son derece karmaşık kod üreten insanüstü bir model hayal edin. İnsanlar bu kodu çalıştırmanın güvenli mi yoksa potansiyel olarak tehlikeli mi olduğunu değerlendirmekte zorlanacaktır. Yalnızca insan denetimine dayanan mevcut hizalama teknikleri artık yeterli olmayabilir.

Bu da bizi temel bir soruna getiriyor: Bizden önemli ölçüde daha akıllı olan yapay zeka sistemlerini nasıl yönlendirebilir ve onlara nasıl güvenebiliriz? OpenAI bunu dünyadaki çözülmemiş en kritik teknik sorunlardan biri olarak kabul ediyor. Bununla birlikte, yoğun bir çabayla bunun çözülebilecek bir sorun olduğuna inanıyorlar. Araştırma topluluğu, bireysel araştırmacılarla birlikte, bu alanda önemli ilerleme kaydetme fırsatına sahiptir.

OpenAI’nin Vizyonu: Araştırma Topluluğuyla İşbirliği Yapmak

OpenAI’nin Superalignment projesi, bu zorluğun üstesinden gelmek için araştırma ve mühendislik alanındaki en iyi beyinleri bir araya getirmeyi amaçlıyor. Yeni bakış açılarının ve fikirlerin bu karmaşık sorunun üstesinden gelmek için çok önemli olduğunun bilincinde olan OpenAI, bu alana yeni bireyler kazandırma konusunda özellikle isteklidir.

OpenAI, insanüstü yapay zeka sistemlerinin uyumunu ve güvenliğini sağlamaya yönelik teknik araştırmaları desteklemek amacıyla Eric Schmidt ile ortaklaşa 10 milyon dolarlık bir hibe programı başlattı. Bu program, akademik laboratuvarlar, kâr amacı gütmeyen kuruluşlar ve bireysel araştırmacılar için 100 bin ila 2 milyon dolar arasında değişen hibeler sunuyor. Ayrıca, yüksek lisans öğrencileri için 150 bin dolar burs ve araştırma fonu sunan bir yıllık bir program olan OpenAI Superalignment Fellowship’e sponsor oluyorlar.

Araştırma İlgi Yönleri: Zayıftan Güçlüye Genellemeyi Keşfetmek

Araştırma yönleri açısından OpenAI, zayıftan güçlüye genelleme ile ilgili projelere fon sağlamaya özel bir ilgi duyduğunu ifade etti. İnsanların bu güçlü sistemler üzerinde aynı düzeyde anlayış ve kontrole sahip olamayabileceği göz önüne alındığında, insanüstü modellerin zayıf denetimden nasıl genelleme yapabileceğini keşfetmeyi amaçlıyorlar. Bir başka büyüleyici ilgi alanı da yorumlanabilirliktir. OpenAI, yapay zeka modellerinin iç işleyişini çözmek ve yapay zeka yalan dedektörü gibi araçlar oluşturmak için bu anlayıştan yararlanmak istiyor.

Ölçeklenebilir gözetim kavramı da YZ sistemlerinin güvenliğini sağlamada çok önemlidir. OpenAI, YZ sistemlerinin karmaşık görevlerde diğer YZ sistemlerinin çıktılarını değerlendirmede insanlara nasıl yardımcı olabileceğini araştırmayı amaçlamaktadır. Bu işbirlikçi yaklaşım, riskleri azaltma ve YZ teknolojisinin genel güvenliğini artırma potansiyeline sahiptir.

Modelin İç Kısımlarını Çözmek: Yorumlanabilirlik Arayışı

Bu özel araştırma yönlerine ek olarak OpenAI, dürüstlük, düşünce zinciri sadakati, düşmanca sağlamlık, değerlendirmeler ve test yatakları ve insanüstü YZ sistemlerinin güvenli bir şekilde geliştirilmesine ve konuşlandırılmasına katkıda bulunan daha birçok yolla ilgili projeleri finanse etmeye açıktır.

OpenAI’nin insanüstü yapay zeka sistemleriyle ilgili zorlukları ele alma konusundaki kararlılığına tanık olmak inkar edilemez derecede heyecan verici. Önemli ölçüde finansal destek sağlayarak ve işbirliğine dayalı bir ortamı teşvik ederek, araştırmacıları ve mühendisleri YZ uyumu alanında önemli ilerlemeler kaydetmeleri için güçlendiriyorlar. Bir YZ meraklısı olarak, bu girişimden kaynaklanacak çığır açıcı keşifleri ve teknolojik gelişmeleri heyecanla bekliyorum.

Sık Sorulan Sorular

Superalignment Fast Grants programı nedir?

Superalignment Fast Grants programı, OpenAI tarafından Eric Schmidt ile işbirliği içinde başlatılan 10 milyon dolarlık bir girişimdir. İnsanüstü yapay zeka sistemlerinin hizalanmasını ve güvenliğini sağlamak için teknik araştırmalar üzerinde çalışan akademik laboratuvarlara, kar amacı gütmeyen kuruluşlara, bireysel araştırmacılara ve lisansüstü öğrencilere finansal destek sağlamayı amaçlamaktadır.

Araştırmacılar Superalignment Fast Grants programına nasıl başvurabilir?

Superalignment Fast Grants programı için başvuru süreci basit ve anlaşılırdır. İlgilenen araştırmacılar başvurularını gönderebilir ve OpenAI, başvuru kapanış tarihinden itibaren dört hafta içinde yanıt vermeyi taahhüt eder.

Hibelere başvurmak için hizalama araştırmalarında önceden deneyim gerekli mi?

Hayır, hibelere başvurmak için hizalama araştırmalarında önceden deneyim şart değildir. OpenAI, hizalama konusunda ilk kez çalışmaktan heyecan duyan araştırmacıları aktif olarak aramaktadır. Farklı bakış açılarının ve yeni fikirlerin, insanüstü yapay zeka sistemlerini hizalamanın zorluklarının üstesinden gelmek için gerekli olduğuna inanıyorlar.

Superalignment Fast Grants programı için ilgi duyulan belirli araştırma yönleri nelerdir?

OpenAI özellikle zayıftan güçlüye genelleme, yorumlanabilirlik ve ölçeklenebilir gözetim ile ilgili araştırma projelerine fon sağlamakla ilgileniyor. İnsanüstü modellerin zayıf denetimden nasıl genelleştirilebileceğini keşfetmeyi, yapay zeka yalan dedektörü gibi araçlar oluşturmak için yapay zeka modelinin iç kısımlarını anlamayı ve karmaşık görevlerde diğer yapay zeka sistemlerinin çıktılarını değerlendirmede insanlara yardımcı olmak için yapay zeka sistemlerinden yararlanmayı amaçlıyorlar.

Ayrıca dürüstlük, düşünce zinciri sadakati, düşmanca sağlamlık, değerlendirmeler ve test ortamları ve daha fazlası dahil olmak üzere diğer araştırma yönlerini de memnuniyetle karşılamaktadırlar.